レビュー・QAの設計|人と自動の役割分担を決めるガイド

アセットのレビュー会議が長引き、リーダーが目視で命名規則や UV をチェックし続け、毎週のように手戻りが発生する──こうした「レビュー疲弊」はゲームスタジオで普遍的な課題です。原因の多くは、レビューの 役割分担 が曖昧なまま運用されていることにあります。

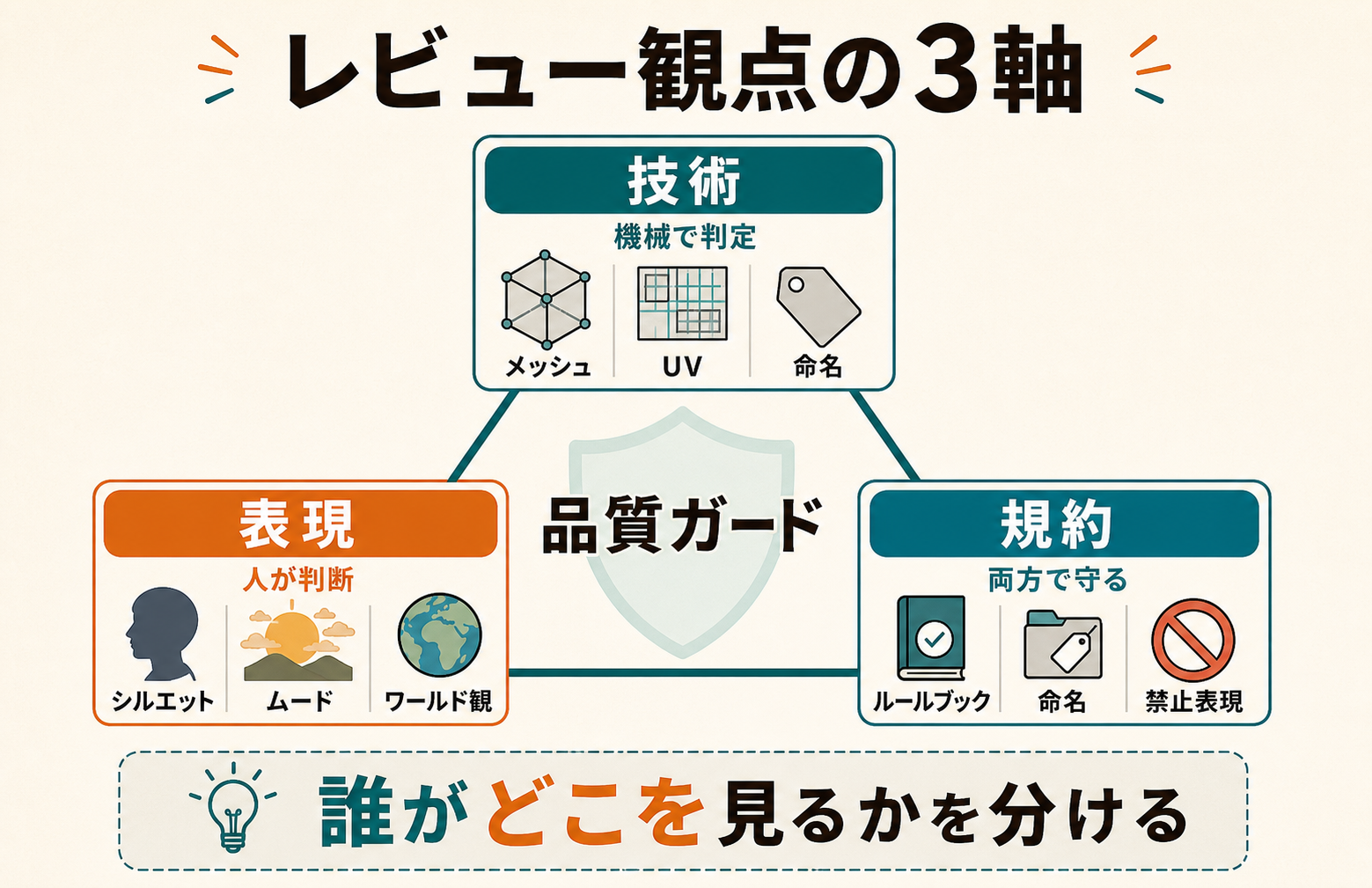

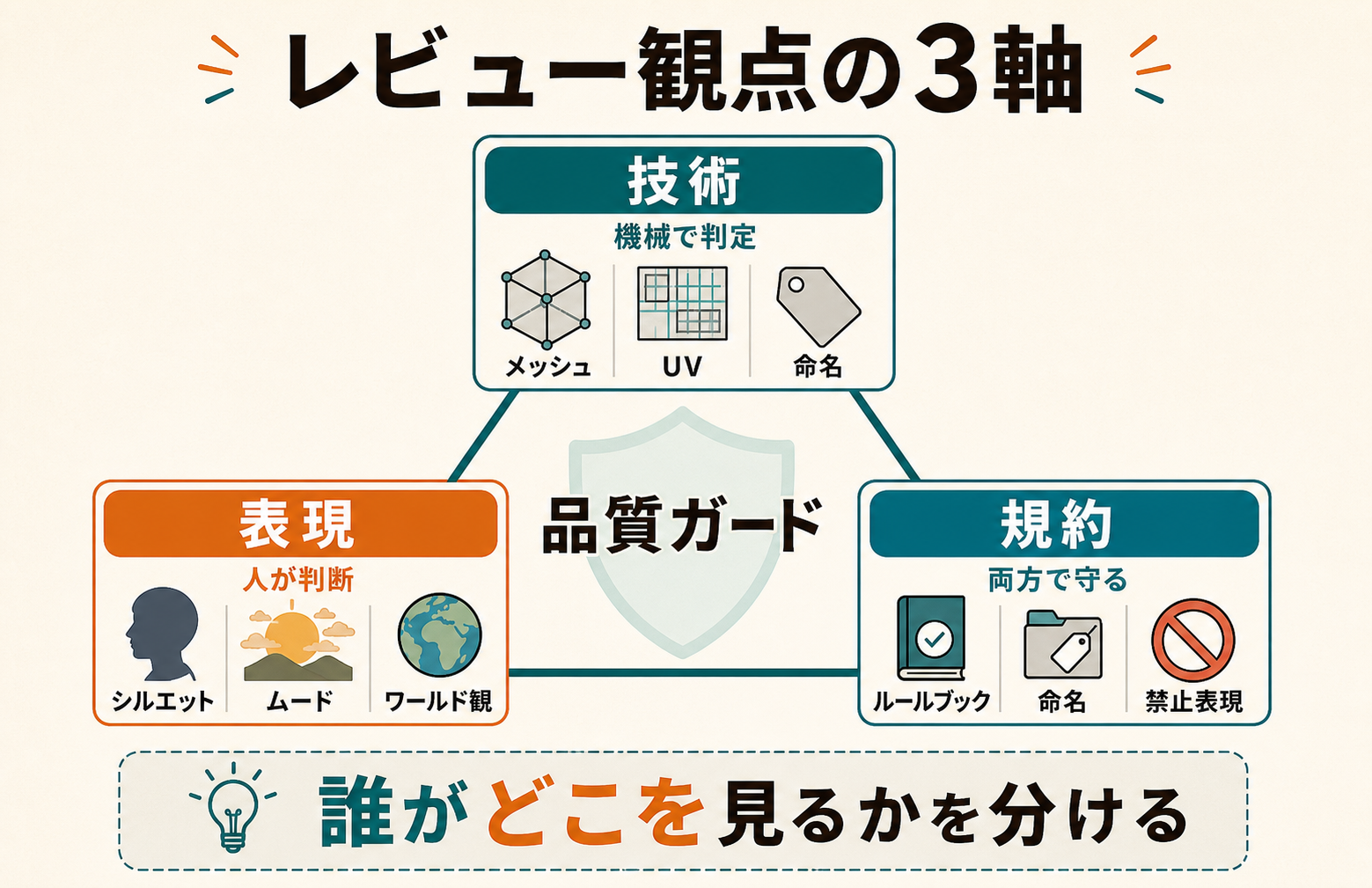

本記事では、レビュー観点を「技術・表現・規約」の3軸に整理し、Validator(バリデータ:データを自動でチェックする検証ツール)で自動化すべき項目と人がやるべき項目の境界を引き、レビューワークフローと心理面の設計までを、TA(テクニカルアーティスト)・リード(チームを率いるベテラン)・PM(プロジェクトマネージャー)視点で整理します。前提として Pythonで横断パイプライン(CR-10) を読んでおくと、Validator の実装イメージが立体的になります。

夕宮たいだ

夕宮たいだふぁ……みんな〜、レビュー設計って地味なんだけどぁ、効くときはほんとに効くんだよぉ。今日は「人と機械の役割分担」をいっしょに考えていこ〜。

1. なぜ品質ガードが必要なのか

ひとことで:個人の集中力に頼ったチェックは、規模が増えると必ず破綻するからです。

品質ガードがない現場で起きることは、ほぼ決まっています。

- アーティストが命名規則を「気をつけて」つけ、ベイク前に Freeze を「思い出して」やる

- リーダーがレビュー時に目視で「気づいたところ」を指摘

- ゲームに組み込んでから「UV がはみ出していた」「メモリオーバー」が判明

- ビルド前夜に大量手戻り、リリース遅延

人間の集中力には限界があります。「気合いと根性」で品質を担保するアプローチは、規模が大きくなった瞬間に破綻します。品質ガードの目的は、繰り返し確認すべきこと を仕組みに移し、人間は 判断が必要なこと に集中できるようにすることです。

品質ガードがもたらす具体的な効果

導入が定着したチームに共通する効果は次のとおりです。

- 手戻りの削減:エラーが Submit 時点で本人に返るため、レビュー段階の指摘が激減

- レビュー時間の短縮:技術指摘が消え、表現議論に時間を使えるようになる

- 新人立ち上がりの加速:暗黙ルールが Validator のメッセージとして文書化される

- 属人性の低下:「あのリードが見ないと不安」がなくなる

逆に言うと、これらの効果が出ない品質ガードは、項目設計か運用のどこかで歪んでいます。導入したのに効果が薄い場合、本記事の後半のチェックリストで運用を見直してみてください。

2. レビュー観点の3軸:技術・表現・規約

ひとことで:観点を「技術・表現・規約」の3軸に分けると、誰がどこを見るかが明確になります。

技術観点

数値・パターンで判定可能な項目です。

- ポリゴン数、UV 重複、テクスチャサイズ、メモリ消費

- 命名規則、ヒストリー残り、Freeze 未済

- 座標系、スムージング、タンジェント

- 機械的に Yes / No が出せるもの

表現観点

「センス」と「経験」が必要な項目です。

- シルエット、プロポーション

- 世界観整合、カラーバランス

- ライティング下での見え方

- 「正解」が一つに定まらないもの

規約観点

プロジェクト固有のルール集で表現できる項目です。

- プロジェクトのスタイルガイド遵守

- ブランド表記、IP(Intellectual Property=知的財産。版権作品の表現)に関する規定

- 競合表現への配慮、レーティング上の禁止表現

- 数値化しにくいが、ルール文書で明示できるもの

下図に3軸の関係を示します。

3軸で整理すると、見通しがすごく良くなるんだぁ。「技術は機械、表現は人、規約は両方」って大まかに思っとくと、迷わないよぉ。

3. 自動でできる範囲:Validator の設計

ひとことで:機械的に Yes / No 判定できる項目は、Validator に任せます。

Validator 向きの項目(自動化のリターンが大きい順)は次のとおりです。

- 命名規則:正規表現で判定

- メッシュ整合:頂点数・面数・トライアングル化の有無

- UV 重複・はみ出し:UV 島の重なりや

(0,0)〜(1,1)の枠外 - ヒストリー残り:DCC API で取得可能

- Freeze 未済:トランスフォーム値が

0/1になっていない - 座標系:エクスポート時の軸方向と一致しているか

- ポリゴン数上限:プロジェクト基準と数値比較

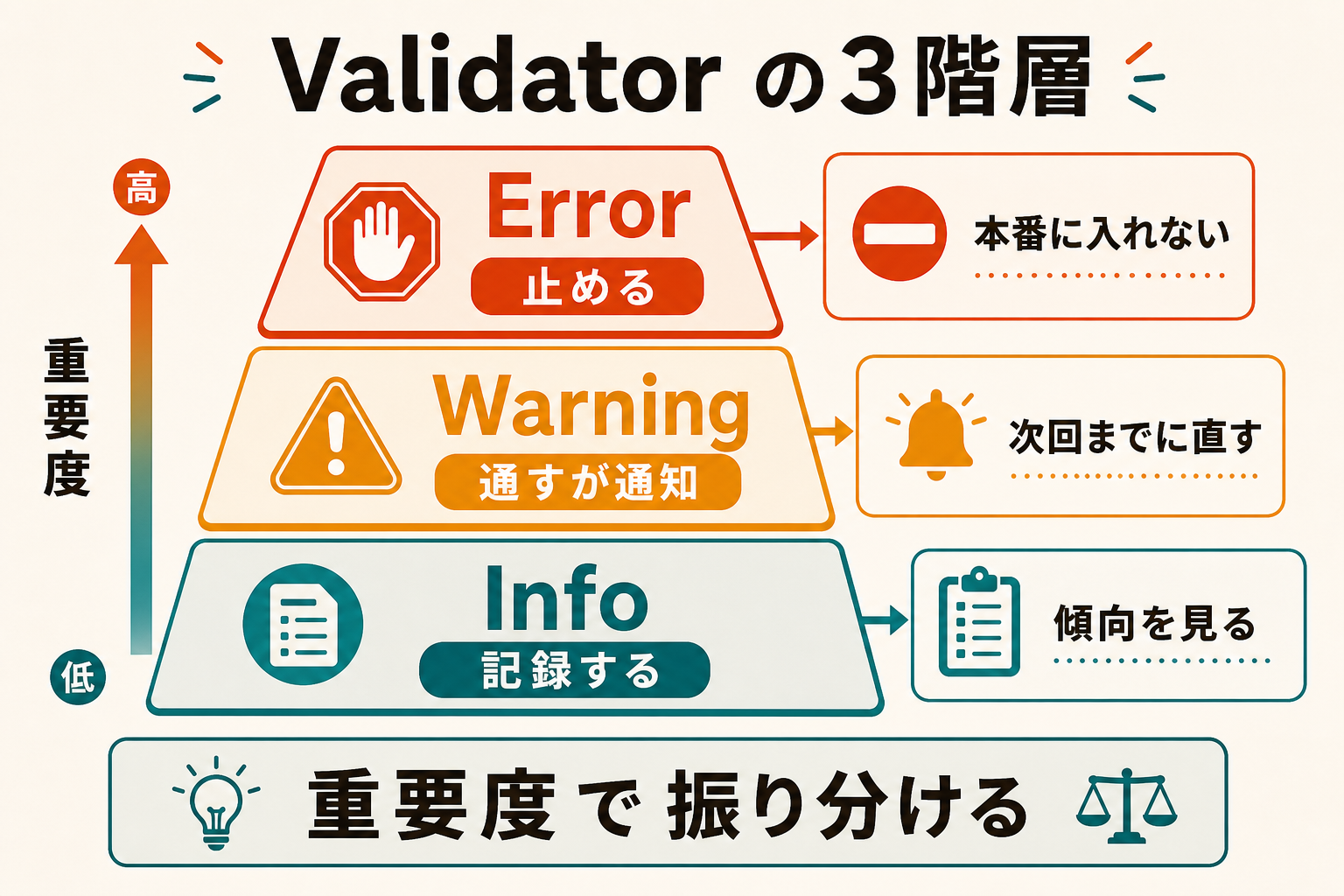

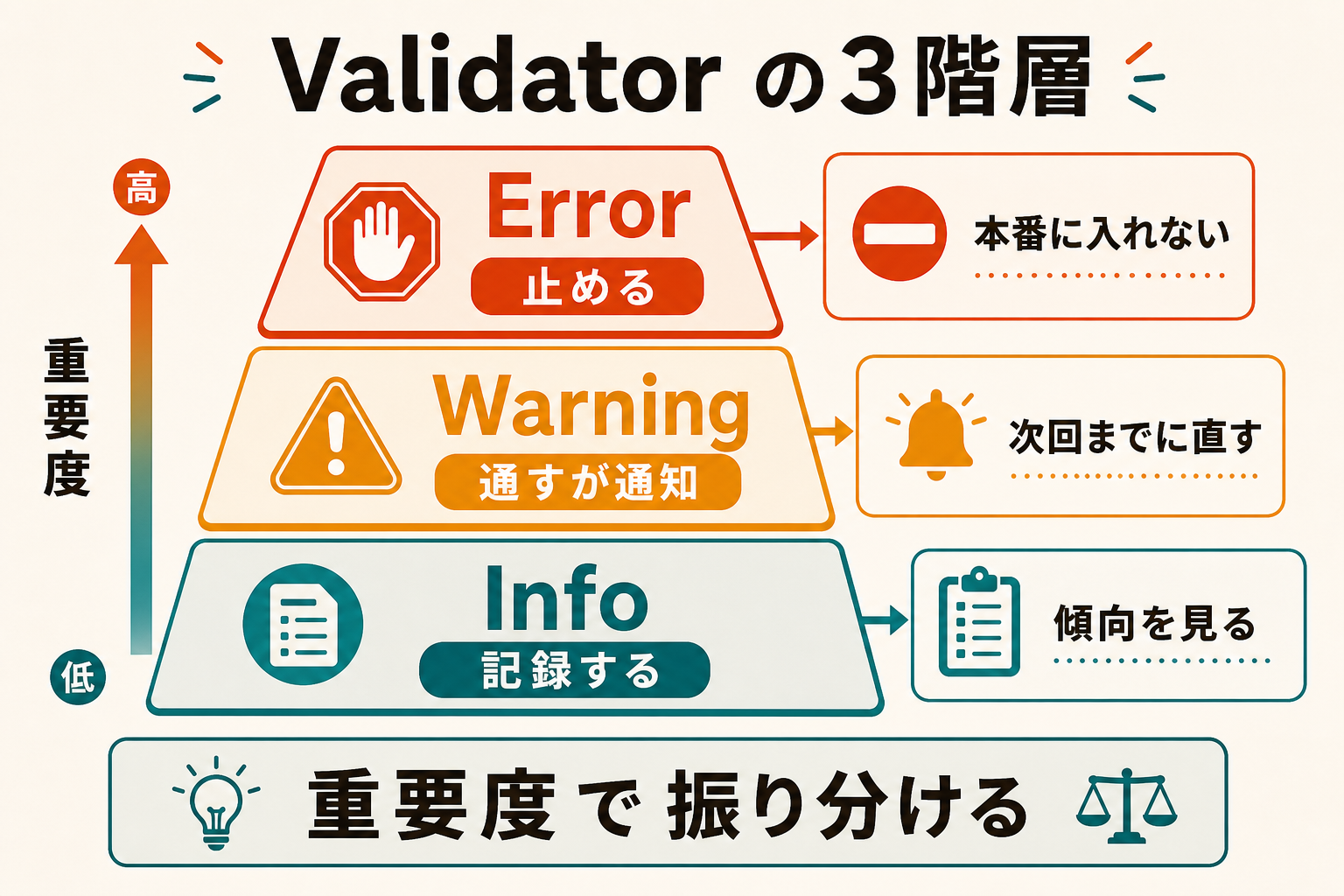

エラー・ワーニング・インフォの3階層

Validator の出力は、3階層に分けるのが定石です。

- エラー(赤):これがあるとビルドできない/リリースできない。修正必須

- ワーニング(黄):望ましくないが、ケースによっては許容できる。判断必要

- インフォ(青):参考情報。確認後にスキップ可

「全部エラー」にすると、些末な指摘で作業が止まります。「全部ワーニング」にすると、徐々に無視されるようになります。重要度を機械側で適切に振り分ける のが Validator 設計の中心です。

ていねいに項目決めるねぇ。エラー、ワーニング、インフォ……「絶対ダメ」「ほどほどダメ」「お知らせ」って整理だよぉ。

自動レポート

Validator の結果は、人が読みやすい形に整形します。

- HTML レポート:成果物単位(アセット名)で集計、サムネイル付き

- Markdown レポート:Pull Request コメント、Slack 投稿に向く

- ターミナル出力:CI ログ、開発時の即時確認用

レポートには「何が・どこで・どう直すか」の3点を含めます。「Naming violation」だけでは弱く、「character_HERO_v01.ma は規則 ^[A-Z][a-zA-Z0-9_]+\.ma$ に違反 → 例:Character_Hero_v01.ma のように先頭大文字+アンダースコア区切りに修正」まで書くと、修正の往復が激減します。

レポート設計の落とし穴

Validator の出力レポートでよくある失敗が、「項目数だけが多くて、優先度が伝わらない」状態です。10件のエラーが平坦に並んでいるレポートと、「致命的 1件 / 重要 3件 / 軽微 6件」のように分類されたレポートでは、修正のしやすさが段違いです。

加えて、レポートからアセットファイルへワンクリックで飛べる リンク設計があると、修正サイクルがさらに短くなります。HTML レポートなら DCC 起動コマンドへの URL スキーム連携、Markdown ならファイルパスのリンク化が候補です。

4. 人がやるべき範囲:表現・全体感

ひとことで:判断・経験・コンテキストが必要なものは、人がやります。

人レビューの典型項目です。

- シルエット:遠景・小サイズで識別できるか

- プロポーション:他キャラ・建造物との対比

- 世界観整合:このゲームのトンマナに合うか

- 演出意図:シーンの感情・物語に合っているか

- キャラクター性:そのキャラらしさが出ているか

これらは「正解」が一つに定まらないため、機械的判定ができません。逆に、Validator で済む内容を人が見ている と、レビュー時間が技術指摘で埋まり、肝心の表現議論に進めなくなります。

ほよ? シルエットや世界観って、人じゃないとダメなんだぁ。技術チェックを Validator に任せて、人は判断に集中する、って分担なんだねぇ。

役職別レビューゲート

段階を分けるのが定石です。

1. アーティスト本人:自己チェック(Validator 出力を見て自分で修正) 2. リードレビュー:技術+表現の細部、チーム内で詰める 3. AD(アートディレクター)レビュー:全体感、世界観整合、最終承認

各ゲートで「何を見るか・何を見ないか」を文書化しておくと、二重指摘や見落としが減ります。

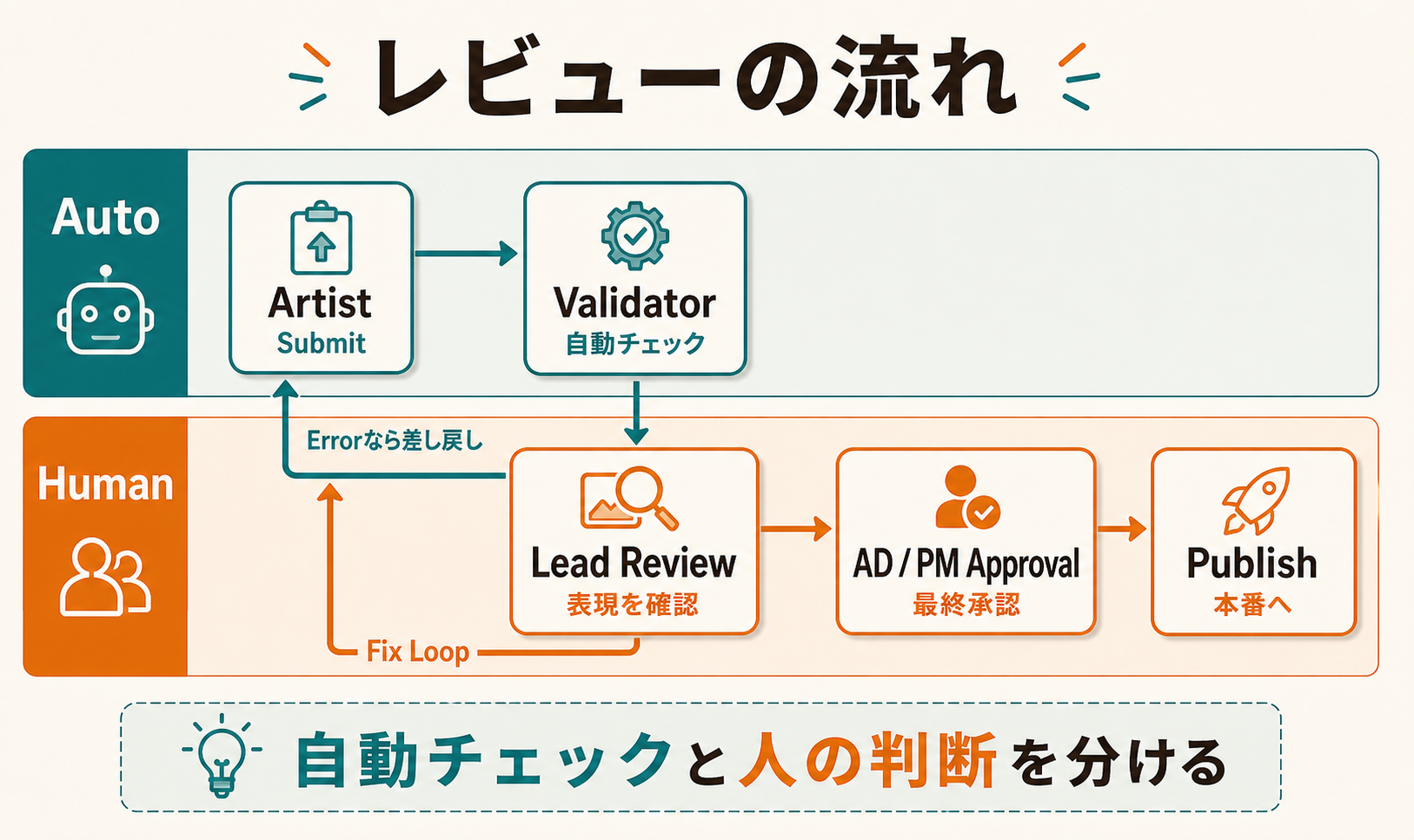

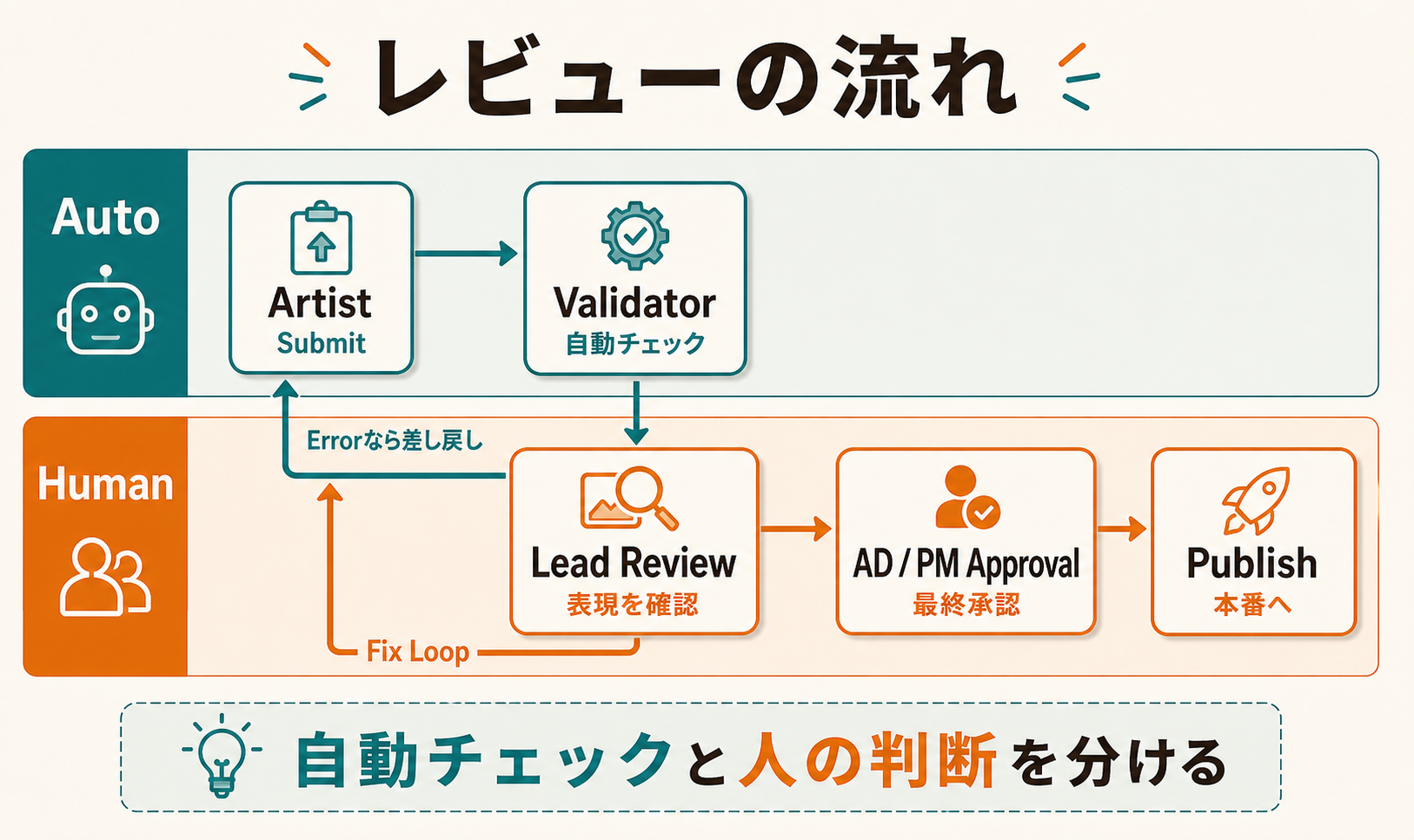

5. レビューワークフローの典型

ひとことで:自動チェック → 手動レビュー → 修正 → 再チェック → 承認、の循環ループを組みます。

典型的なフローは次のとおりです。

1. アーティストが Submit:成果物を提出 2. 自動 Validator 実行:CI またはサーバー側スクリプトで実行 3. エラーがあれば自動差し戻し:本人修正後に再 Submit 4. 手動レビュー:リードが表現・コンテキストをチェック 5. 修正指示:具体的なフィードバック 6. 再 Submit:必要に応じてループ 7. 承認:AD ゲート通過後、本番へマージ

このループの肝は、ステップ 2 を人が肩代わりしないこと です。Validator が出すべきエラーをリードが目視で見つける運用は、自動化が機能していないサインです。

レビューミーティングの設計

- 頻度:週1回(多すぎず少なすぎず)

- 時間:1時間以内(長引くと集中力が切れる)

- 人数:3〜5名(多いと議論が拡散)

- 議題粒度:1アセット 5〜10 分

「全アセットを毎回見る」ではなく、Validator で弾けないもの・判断が必要なもの に絞ります。

ツール例

- Shotgrid(旧 Shotgun):レビュー・ステータス管理の業界標準

- ftrack:類似のレビュー基盤

- Perforce Swarm:Perforce ベースのコードレビュー、アセット運用にも応用可

- GitLab / GitHub:コード中心だが、Markdown レポートと相性が良い

ツールはチーム規模・予算・既存ワークフローで選びます。「Shotgrid を入れたから良くなる」ではなく、役割分担が明確だから、どのツールでも回る が本質です。最初は既存の Slack や Excel ベースで運用を回し、ルールが安定してから専用ツールに移行するのも、十分に現実的な選択肢です。

6. レビュー疲れと心理設計

ひとことで:心理的安全性とフィードバックの質が、レビュー継続率を決めます。

レビューは「指摘される側」も「する側」も消耗します。長期運用には心理面の設計が不可欠です。

心理的安全性

- 「誰がミスしたか」ではなく「何が起きたか」に焦点

- 公開の場での個人攻撃を避ける

- Validator のエラーは「個人の責任」ではなく「仕組みの隙間」と捉える

「ミスを責める文化」を放置すると、アーティストは Validator のエラーを隠したり、ギリギリまで Submit を避けたりします。短期的にはミスが減ったように見えても、長期的には品質も信頼も毀損します。

フィードバックの言い回し

- ✕「ダメです、修正してください」

- ◯「シルエットがぼやけて見えるので、肩ラインを少し強調すると認識性が上がりそうです」

具体的な観点と、可能なら改善方向を添えます。これは技術的指摘でも同じで、「UV が変です」より「UV 島 #3 が (0,0)〜(1,1) をはみ出しているため、エディタ画面で右下に圧縮し直すと収まります」が圧倒的に修正コストが低くなります。

ぁぅ……メンタルの設計、ほんと大事なんだよぉ。レビュー疲れで離脱されちゃったら、品質も何もないからねぇ。気をつけてねぇ。

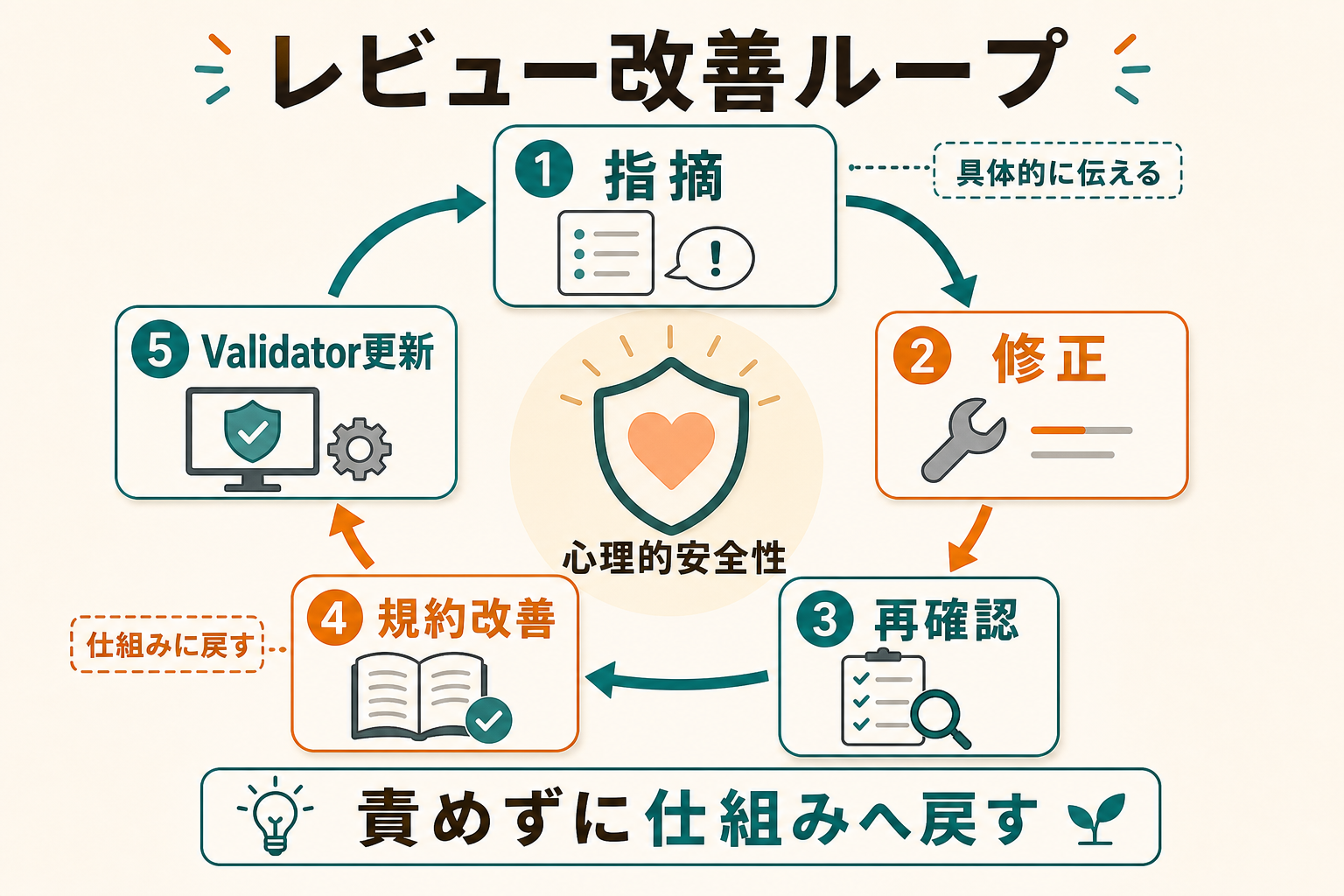

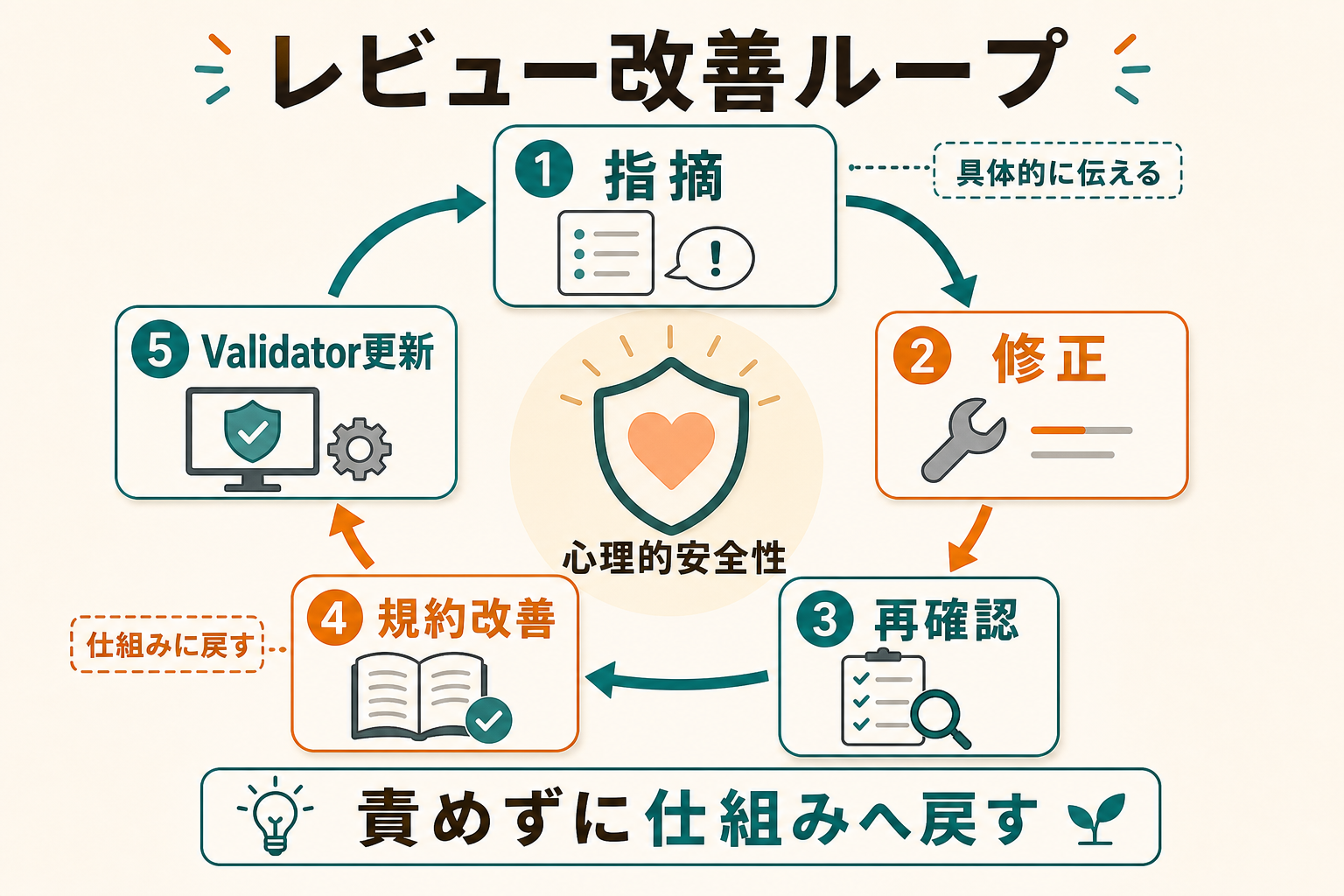

改善ループ

- 月次でレビュー運用そのものを振り返る

- 「Validator の項目を増やす/減らす」「ゲートを統合/分離」を定期見直し

- アーティスト側からのフィードバックも積極的に吸い上げる

「最初に作ったルールが永遠」ではなく、「運用しながら育てる」が前提です。

Validator メッセージの言語設計

意外と見落とされがちですが、Validator が出力するメッセージそのものの 言葉遣い も心理面に影響します。

- ✕「Validation FAILED: invalid name」

- ◯「命名規則に一致しません。ファイル名を

Character_Hero_v01.maのようにしてください」

技術的に同じ情報でも、人が読んで対応しやすい文面 に整えるかどうかで、Validator の運用定着率が変わります。エラーメッセージは UI の一部、という意識を持つと品質が上がります。

7. ハンズオン演習

ひとことで:自プロジェクトのレビュー観点を、3軸に分類してリスト化してみましょう。

最小ハンズオンの手順です。

1. 現在レビューでチェックしている項目をすべて書き出す(30〜50項目) 2. 各項目を「技術 / 表現 / 規約」のどれに該当するか分類 3. 技術観点を「Validator 化可能 / 不可」でさらに分類 4. Validator 化可能な項目から、優先順位を付けて1つずつ実装

最初の Validator は「命名規則チェック」だけで十分です。1つ動かしてからアーティストの反応を見て、次を決めます。一気に全項目を実装しようとすると、チームが受け入れる前にツールだけ肥大化 します。

導入直後の1〜2週間は、エラーを「強制」ではなく「警告」として運用するのも有効です。アーティスト側が修正に慣れ、メッセージへの信頼が育ったタイミングで、エラー強制に切り替えると定着率が上がります。最初から強制すると、「Validator が邪魔」という印象が固定化されてしまうリスクがあります。

8. チェックリスト

ひとことで:レビュー設計時のセルフチェック項目です。

- [ ] レビュー観点を3軸(技術・表現・規約)に分類している

- [ ] 自動化可能な項目を Validator に移している

- [ ] Validator がエラー・ワーニング・インフォの3階層を持っている

- [ ] 自動レポートが「何が・どこで・どう直すか」を含んでいる

- [ ] 役職別レビューゲート(本人 / リード / AD)を設計している

- [ ] レビューミーティングが時間・頻度・粒度で運用ルール化されている

- [ ] フィードバックの言い回しに心理的安全性を意識している

- [ ] 月次でレビュー運用そのものを振り返っている

9. よくある間違い・トラブルシュート

ひとことで:人が Validator の代わりをする・Validator が厳しすぎる・ゲートが多すぎる・フィードバックが具体性を欠く、の4つが定番です。

人が Validator の代わりをしている

- 症状:リードが命名規則・UV 重複を毎回目視チェック、レビュー会議が技術指摘で埋まる

- 対処:自動化可能な項目を Validator に移す。リードは判断系の項目に集中

Validator が厳しすぎる

- 症状:些末な指摘で作業が止まる、Validator のエラーが無視されるようになる

- 対処:エラー/ワーニング/インフォの3階層を見直し、「絶対ダメ」だけをエラーに振り分ける

レビューゲートが多すぎる

- 症状:承認まで時間がかかる、誰が承認すべきかわからない

- 対処:ゲートを3段階以内に集約。各ゲートの責任範囲と「何を見ないか」を文書化

フィードバックが具体性を欠く

- 症状:「ダメです」のみで修正方向が伝わらない、何度も差し戻しになる

- 対処:観点+現状+改善方向 の3点セットでフィードバックする習慣を作る

ふぁ……レビュー設計、最初は地味だけど、回り始めると現場が一気に楽になるんだよぉ。次は命名規則や最適化チェックリストに進めるよ〜。

10. 次に読む記事

ひとことで:レビュー設計を、命名・パイプライン・最適化に繋げていきましょう。

- CR-09 アセット命名・バージョン規則:レビュー以前の土台になる命名規約

- CR-10 Pythonで横断パイプライン:Validator 実装の基盤

- CR-11 リアルタイム最適化チェックリスト:技術観点 Validator の項目候補

- CR-08 USD入門:レイヤー単位のレビュー設計に応用できる仕組み

—